11 fichiers modifiés avec 23 ajouts et 23 suppressions

BIN

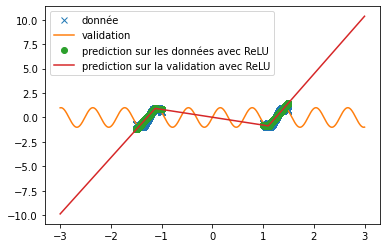

code/fonctions_activations_classiques/prediction_sinus_ReLU.png

Voir le fichier

BIN

code/fonctions_activations_classiques/prediction_sinus_snake.png

Voir le fichier

BIN

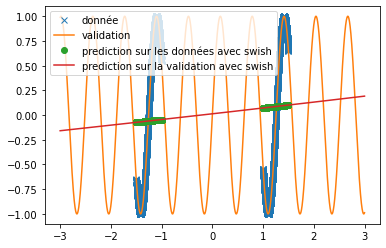

code/fonctions_activations_classiques/prediction_sinus_swish.png

Voir le fichier

BIN

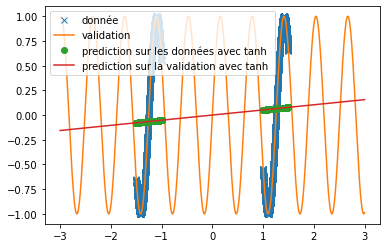

code/fonctions_activations_classiques/prediction_sinus_tanh.png

Voir le fichier

BIN

code/fonctions_activations_classiques/prediction_x2_ReLU.png

Voir le fichier

BIN

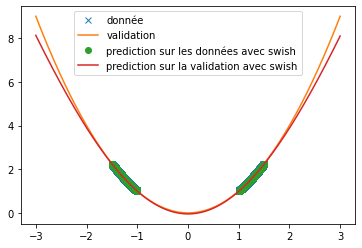

code/fonctions_activations_classiques/prediction_x2_swish.png

Voir le fichier

BIN

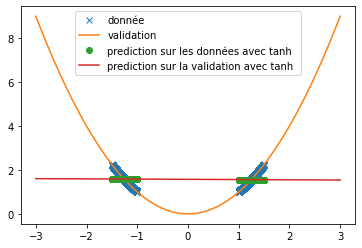

code/fonctions_activations_classiques/prediction_x2_tanh.png

Voir le fichier

+ 10

- 10

code/fonctions_activations_classiques/sin.py

Voir le fichier

| import numpy as np | import numpy as np | ||||

| w=10 | w=10 | ||||

| n=20 | |||||

| n=2000 | |||||

| #création de la base de donnéé | #création de la base de donnéé | ||||

| X,Y=creation_sin(-1.5,-1,n,w) | |||||

| X,Y=creation_sin(-2.5,-1,n,w) | |||||

| X2,Y2=creation_sin(1,1.5,n,w) | X2,Y2=creation_sin(1,1.5,n,w) | ||||

| X=np.concatenate([X,X2]) | X=np.concatenate([X,X2]) | ||||

| Y=np.concatenate([Y,Y2]) | Y=np.concatenate([Y,Y2]) | ||||

| model_sin.add(tf.keras.Input(shape=(1,))) | model_sin.add(tf.keras.Input(shape=(1,))) | ||||

| # model_sin.add(tf.keras.layers.Dense(64, activation=sin)) | |||||

| # model_sin.add(tf.keras.layers.Dense(64, activation=sin)) | |||||

| # model_sin.add(tf.keras.layers.Dense(64, activation=sin)) | |||||

| # model_sin.add(tf.keras.layers.Dense(64, activation=sin)) | |||||

| # model_sin.add(tf.keras.layers.Dense(512, activation=sin)) | |||||

| # model_sin.add(tf.keras.layers.Dense(64, activation=sin)) | |||||

| model_sin.add(tf.keras.layers.Dense(8, activation=sin)) | |||||

| model_sin.add(tf.keras.layers.Dense(64, activation=sin)) | |||||

| model_sin.add(tf.keras.layers.Dense(64, activation=sin)) | |||||

| model_sin.add(tf.keras.layers.Dense(64, activation=sin)) | |||||

| model_sin.add(tf.keras.layers.Dense(64, activation=sin)) | |||||

| model_sin.add(tf.keras.layers.Dense(64, activation=sin)) | |||||

| model_sin.add(tf.keras.layers.Dense(64, activation=sin)) | |||||

| # model_sin.add(tf.keras.layers.Dense(8, activation=sin)) | |||||

| model_sin.add(tf.keras.layers.Dense(1)) | model_sin.add(tf.keras.layers.Dense(1)) | ||||

| opti=tf.keras.optimizers.Adam() | opti=tf.keras.optimizers.Adam() | ||||

| model_sin.summary() | model_sin.summary() | ||||

| model_sin.fit(X, Y, batch_size=16, epochs=1000, shuffle='True',validation_data=(Xv, Yv)) | |||||

| model_sin.fit(X, Y, batch_size=16, epochs=150, shuffle='True',validation_data=(Xv, Yv)) | |||||

+ 4

- 4

code/fonctions_activations_classiques/snake.py

Voir le fichier

| w=10 | w=10 | ||||

| n=20000 | n=20000 | ||||

| #création de la base de donnéé | #création de la base de donnéé | ||||

| X,Y=creation_sin(-1.5,-1,n,w) | |||||

| X,Y=creation_sin(-2.5,-1,n,w) | |||||

| X2,Y2=creation_sin(1,1.5,n,w) | X2,Y2=creation_sin(1,1.5,n,w) | ||||

| X=np.concatenate([X,X2]) | X=np.concatenate([X,X2]) | ||||

| Y=np.concatenate([Y,Y2]) | Y=np.concatenate([Y,Y2]) | ||||

| model_sin.summary() | model_sin.summary() | ||||

| model_sin.fit(X, Y, batch_size=16, epochs=10, shuffle='True',validation_data=(Xv, Yv)) | |||||

| model_sin.fit(X, Y, batch_size=16, epochs=100, shuffle='True',validation_data=(Xv, Yv)) | |||||

| plt.figure() | plt.figure() | ||||

| plt.plot(X,Y,'x',label='donnée') | plt.plot(X,Y,'x',label='donnée') | ||||

| plt.plot(Xv,Yv,label="validation") | plt.plot(Xv,Yv,label="validation") | ||||

| plt.plot(X,Y_predis_sin,'o',label='prediction sur les données avec sin ') | |||||

| plt.plot(Xv,Y_predis_validation_sin,label='prediction sur la validation avec sin') | |||||

| plt.plot(X,Y_predis_sin,'o',label='prediction sur les données avec snake') | |||||

| plt.plot(Xv,Y_predis_validation_sin,label='prediction sur la validation avec snake') | |||||

| plt.legend() | plt.legend() | ||||

| plt.show() | plt.show() | ||||

+ 5

- 5

code/fonctions_activations_classiques/swish.py

Voir le fichier

| import numpy as np | import numpy as np | ||||

| w=10 | w=10 | ||||

| n=20 | |||||

| n=2000 | |||||

| #création de la base de donnéé | #création de la base de donnéé | ||||

| X,Y=creation_x2(-1.5,-1,n) | |||||

| X2,Y2=creation_x2(1,1.5,n) | |||||

| X,Y=creation_sin(-1.5,-1,n,w) | |||||

| X2,Y2=creation_sin(1,1.5,n,w) | |||||

| X=np.concatenate([X,X2]) | X=np.concatenate([X,X2]) | ||||

| Y=np.concatenate([Y,Y2]) | Y=np.concatenate([Y,Y2]) | ||||

| n=10000 | n=10000 | ||||

| Xv,Yv=creation_x2(-3,3,n) | |||||

| Xv,Yv=creation_sin(-3,3,n,w) | |||||

| model_swish.summary() | model_swish.summary() | ||||

| model_swish.fit(X, Y, batch_size=1, epochs=16, shuffle='True',validation_data=(Xv, Yv)) | |||||

| model_swish.fit(X, Y, batch_size=16, epochs=50, shuffle='True',validation_data=(Xv, Yv)) | |||||

+ 4

- 4

code/fonctions_activations_classiques/tanh_vs_ReLU.py

Voir le fichier

| from Creation_donnee import * | from Creation_donnee import * | ||||

| import numpy as np | import numpy as np | ||||

| w=10 | w=10 | ||||

| n=20 | |||||

| n=2000 | |||||

| #création de la base de donnéé | #création de la base de donnéé | ||||

| X,Y=creation_x2(-1.5,-1,n) | |||||

| X2,Y2=creation_x2(1,1.5,n) | |||||

| X,Y=creation_sin(-1.5,-1,n,w) | |||||

| X2,Y2=creation_sin(1,1.5,n,w) | |||||

| X=np.concatenate([X,X2]) | X=np.concatenate([X,X2]) | ||||

| Y=np.concatenate([Y,Y2]) | Y=np.concatenate([Y,Y2]) | ||||

| n=10000 | n=10000 | ||||

| Xv,Yv=creation_x2(-3,3,n) | |||||

| Xv,Yv=creation_sin(-3,3,n,w) | |||||

Chargement…